Microsoft, les cinquante premières années

Insubmersible. Même la vague des Gafa n’a pas vraiment atteint Microsoft. Cinquante ans après sa création, soit une éternité dans le monde de la tech, la firme de Bill Gates et Paul Allen est toujours là et bien là. Retour sur ce qu’on appelle outre-Atlantique, une success-story avec quelques échecs.

Cette semaine, Microsoft fête ses 50 ans. Cet article a été écrit sur Microsoft Word, à partir d’un ordinateur équipé de Microsoft Windows, et il sera vraisemblablement publié sur des plateformes hébergées par Microsoft Azure, notamment LinkedIn, une filiale de Microsoft qui compte plus d’un milliard d’utilisateurs. C’est dire l’influence de cette entreprise qui, en 2024, a dégagé un bénéfice net de 88 milliards de dollars pour un chiffre d’affaires de 245 milliards. Sa valeur en Bourse tutoie les 3 000 milliards de dollars, ce qui en fait la deuxième valorisation boursière au monde, derrière Apple et quasiment à égalité avec NVidia. Ses profits cumulés, depuis 2002, approchent les 640 milliards de dollars.

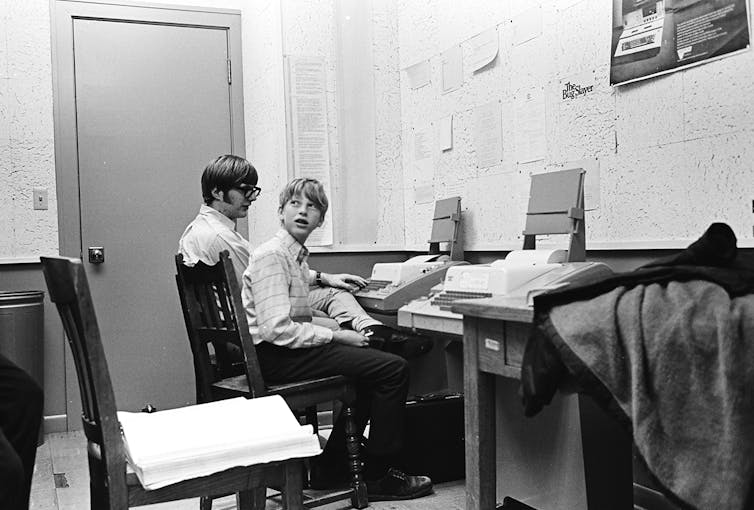

Pourtant, il y a 50 ans, Microsoft n’était qu’une toute petite entreprise d’informatique fondée à Albuquerque, au Nouveau-Mexique (et non en Californie) par deux anciens étudiants de Harvard, Bill Gates et Paul Allen, âgés respectivement de 19 et 22 ans. Les péripéties qui lui ont permis de devenir une des entreprises les plus puissantes au monde sont multiples, et on peut les rassembler en quatre époques.

Première époque : Bill Gates grimpe sur les épaules d’IBM

À la fin des années 1970, le leader incontesté de l’informatique, IBM, réalise que les micro-ordinateurs proposés par les jeunes entrepreneurs de la Silicon Valley, comme l’Apple II, risquent à terme de faire de l’ombre à ses gros systèmes. Le projet IBM PC est alors lancé. Rapidement, il apparaît que la lourdeur des processus internes de l’entreprise ne lui permettra pas de livrer un micro-ordinateur dans les temps. Il est alors décidé que les différents composants de la machine pourront être sous-traités à des fournisseurs externes.

Pour le système d’exploitation, plusieurs entreprises spécialisées sont sollicitées, mais toutes refusent de travailler avec IBM, qu’elles considèrent comme l’ennemi à abattre, symbole de l’informatique centralisée et bureaucratique. C’est alors que Mary Maxwell Gates, qui siège au conseil d’administration d’une ONG à côté du président d’IBM, suggère le nom de son fils William, surnommé Bill, qui vient de créer Microsoft. Un premier contact est pris en 1980.

Problème, Microsoft n’est pas du tout spécialiste des systèmes d’exploitation, mais du langage de programmation BASIC. Qu’à cela ne tienne : Bill Gates, avec un culot incroyable, accepte de signer avec IBM pour lui livrer un système d’exploitation qu’il n’a pas. Il rachète le système QDOS, de l’entreprise Seattle Computer Products, à partir duquel il développe le MS-DOS (MS pour Microsoft).

Deuxième coup de poker, Bill Gates, dont le père est associé fondateur d’un grand cabinet d’avocats de Seattle, propose à IBM un contrat qui prévoit que l’utilisation de MS-DOS ne sera pas exclusive, ce qui lui donne le droit de le vendre à d’autres entreprises informatiques. IBM, peu habitué à la sous-traitance, ne se méfie pas. Ce contrat fera la fortune de Microsoft et le malheur d’IBM : Compaq, Olivetti ou Hewlett-Packard s’empressent de développer des clones de l’IBM PC, donnant naissance à une véritable industrie.

Portée par ce formidable succès (l’image de sérieux d’IBM séduit les entreprises, et Microsoft touche une redevance sur chaque PC vendu), l’entreprise est introduite en Bourse en 1986. Bill Gates, Paul Allen et deux de leurs premiers employés deviennent milliardaires et 12 000 autres salariés de Microsoft, millionnaires.

Deuxième époque : Windows, la poule aux œufs d’or héritée de Xerox

Au milieu des années 1980, les micro-ordinateurs sont peu ergonomiques : leurs systèmes d’exploitation, dont le MS-DOS de Microsoft, fonctionnent avec des lignes de commande particulièrement rébarbatives (le fameux C :/). Tout change en 1984 avec l’Apple Macintosh, équipé d’une interface graphique (icônes, menus déroulants, souris, polices de caractères, etc.). Cette technologie révolutionnaire a été mise au point dans le laboratoire de recherche de Xerox, mais le géant des photocopieurs n’a pas compris son potentiel. Steve Jobs, le patron d’Apple, s’en est très largement inspiré. Pour assurer le succès commercial du Macintosh, il demande à Microsoft de développer une version adaptée de sa suite bureautique, et notamment son tableur Excel. C’est ainsi que Microsoft récupère le principe de l’interface graphique, ce qui lui permet de lancer Windows 1 dès 1985, bientôt accompagné de la suite Office (Word, Excel et Powerpoint).

Windows est amélioré tout au long des années suivantes, pour culminer avec Windows 95, lancé en 1995 avec une campagne publicitaire de plus de 200 millions de dollars, pour laquelle Bill Gates achète aux Rolling Stones le droit d’utiliser leur chanson « Start Me Up ». La part de marché mondial de Microsoft dans les systèmes d’exploitation dépasse alors les 70 %. Elle n’a guère changé depuis.

En 1997, Microsoft se paye même le luxe de sauver Apple de la faillite en investissant 150 millions de dollars dans son capital sous forme d’actions sans droits de vote, qui sont revendues trois ans plus tard. Steve Jobs remercie Bill Gates lors d’une de ses célèbres keynotes en affirmant : « Le monde est meilleur, merci. » Accessoirement, ce sauvetage permet de mettre fin au procès qu’Apple avait intenté à Microsoft en l’accusant d’avoir copié son interface graphique pour concevoir Windows.

Troisième époque : bureaucratisation, conflits internes et diversifications ratées

Au milieu des années 1990, l’informatique connaît une nouvelle transformation avec l’explosion du Web. Or, Microsoft, spécialiste des PC autonomes, dont le modèle économique consiste à vendre des logiciels en boîte, est mal préparé pour cette mise en réseau globale. Sa première réaction est la mise au point du navigateur Internet Explorer, (en fait développé à partir du rachat du navigateur Mosaic conçu par l’entreprise Spyglass, un peu comme le MS-DOS en son temps). Internet Explorer finit par être intégré à Windows, ce qui déclenche un procès pour abus de position dominante qui aurait pu entraîner le démantèlement de Microsoft. De nouveaux concurrents, comme Google avec son navigateur Chrome, en profitent pour attirer les utilisateurs.

En 2000, Bill Gates cède son poste de directeur général de Microsoft à Steve Ballmer, un de ses anciens camarades d’Harvard, qui souhaite en faire une entreprise d’appareils électroniques et de services. Pour cela, Ballmer mène pendant les quinze années suivantes toute une série de diversifications : jeux vidéo (Flight Simulator), encyclopédie sur CD (Encarta), matériel informatique (souris, claviers), lecteur MP3 (Zune), hébergement en ligne (Azure), console de jeux (Xbox), téléphones (Windows Phone), tablettes et ordinateurs (Surface).

Si certaines de ces diversifications sont des réussites (notamment Azure et la Xbox), d’autres sont des échecs cuisants. Encarta est vite submergée par Wikipédia, le Zune ne résiste pas à l’iPod d’Apple, tandis que Windows Phone reste l’une des plus grandes erreurs stratégiques de l’histoire de l’entreprise. En effet, pour assurer son succès dans la téléphonie face à l’iPhone, Microsoft rachète la division « téléphones mobiles » du Finlandais Nokia pour 5,4 milliards de dollars en septembre 2013. L’intégration est catastrophique. Steve Ballmer souhaite que les téléphones utilisent une version de Windows 10, ce qui les rend aussi lents que peu ergonomiques. À peine deux ans plus tard, Microsoft stoppe son activité de téléphonie, en accusant une perte de 7,6 milliards de dollars. Nokia est revendu pour seulement 350 millions de dollars.

Une des conséquences de ces multiples diversifications est l’explosion des effectifs de Microsoft, qui passent de 61 000 personnes en 2005 à 228 000 en 2024. De nombreux conflits internes éclatent entre les différentes divisions, qui refusent de travailler ensemble.

Ces guerres de territoires, doublées d’une bureaucratisation envahissante et d’une rentabilité sans effort (pour chaque installation de Windows, les fabricants de PC payent environ 50 dollars, alors que le coût marginal de cette licence est virtuellement nul), brident la capacité d’innovation de Microsoft. Ses logiciels, notamment Internet Explorer 6 ou Windows Vista, sont bientôt moqués par les utilisateurs pour leurs imperfections, constamment colmatées par de fréquentes mises à jour. Comme le font remarquer certains, Windows est équipé d’un mode « sans échec », ce qui laisse supposer que son mode normal est « avec échec ».

Quatrième époque : Microsoft à nouveau cool grâce au Cloud et à OpenAI ?

En 2014, Satya Nadella remplace Steve Ballmer à la tête de Microsoft. Venu de la division des services en ligne, il va réorienter la stratégie de Microsoft dans cette direction, en développant notamment l’activité d’hébergement Azure. En 2024, Azure est ainsi devenu le deuxième service de Cloud au monde, derrière AWS d’Amazon, et plus de 56 % du chiffre d’affaires de Microsoft proviennent de ses services en ligne. Satya Nadella modifie à cette occasion le modèle économique de l’entreprise : désormais, les logiciels ne doivent plus être vendus, mais accessibles par abonnement, ce qui donne naissance, par exemple, à Office 365 et à Xbox Live.

Parallèlement, Microsoft acquiert le jeu en ligne Minecraft en 2014, puis le réseau social professionnel LinkedIn en 2016 pour 26,2 milliards de dollars (ce qui constitue sa plus grosse acquisition à ce jour), et la plateforme de développement en ligne GitHub en 2018 pour 7,5 milliards de dollars.

Enfin, entre 2023 et 2025, Microsoft investit plus de 14 milliards dans OpenAI, la société à l’origine de ChatGPT, ce qui lui donne une position particulièrement enviable dans la révolution de l’intelligence artificielle. Les modèles de ChatGPT viennent enrichir l’IA interne de Microsoft, Copilot.

Au total, en 50 ans, grâce à une série de paris téméraires, de rachats opportuns, mais aussi de diversifications ratées, Microsoft a connu une évolution significative de sa stratégie, que ce soit en matière de périmètre, d’avantage concurrentiel ou de modèle économique. Un temps étouffée par son opulence et ses conflits internes, l’entreprise semble redevenir attractive, notamment pour les jeunes diplômés. Pour autant, rien ne dit que Microsoft existera encore pendant 50 nouvelles années. D’ailleurs, Bill Gates lui-même a annoncé le contraire.![]()

Frédéric Fréry, Professeur de stratégie, CentraleSupélec, ESCP Business School

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

.jpg)