Interdire les réseaux sociaux aux mineurs : un frein aux alternatives vertueuses ?

La proposition de loi visant à « protéger les mineurs des risques auxquels les expose l’utilisation des réseaux sociaux » sera bientôt examinée par le Sénat. Elle élude le cœur du problème : le modèle économique fondé sur la captation de l’attention. Sans s’attaquer à cette architecture, la régulation risque de manquer sa cible.

Loin de cibler les plateformes toxiques bien connues, la proposition de loi visant à « protéger les mineurs des risques auxquels les expose l’utilisation des réseaux sociaux » pourrait entraver l’émergence d’alternatives vertueuses pour nos écosystèmes d’information et de communication. Les sciences humaines et sociales ne sont pourtant pas avares de propositions systémiques plus constructives.

Des mois de débats stériles sans définition valable

Adopté par l’Assemblée nationale le 26 janvier 2026, le projet de loi visant à interdire les réseaux aux moins de quinze ans bénéficie d’une procédure accélérée à la demande du gouvernement. En accord avec la rapporteure Laure Miller, le gouvernement a fait voter un amendement qui gomme toute distinction entre des réseaux sociaux identifiés comme dangereux après avis de l’Arcom et les réseaux sociaux en général : tous sont désormais explicitement désignés comme « dangereux pour les moins de 15 ans ». De fait, le législateur n’apporte aucun élément pour définir ce qu’il propose d’interdire. Il faut se tourner vers le droit européen pour savoir de quoi il est question.

Selon le Digital Market Act (DMA) européen, un réseau social est un « service de plateforme essentiel […] permettant aux utilisateurs finaux de se connecter ainsi que de communiquer entre eux, de partager des contenus et de découvrir d’autres utilisateurs et d’autres contenus, sur plusieurs appareils et, en particulier, au moyen de conversations en ligne (chats), de publications (posts), de vidéos et de recommandations ». Sur la base d’une telle définition, le projet de loi français rate sa cible et confond réseaux socionumériques et médias sociaux en ligne, pénalisant les réseaux sociaux qui méritent encore d’être désignés comme tels.

Or de tels réseaux ne manquent pas. Nous ne parlons pas seulement des substituts aux services de microblogging que sont Mastodon ou Bluesky. Les projets réellement alternatifs sont peu connus et balbutiants faute de moyens dans un espace dominé par les grandes plateformes toxiques des BigTech. Vous connaissez TikTok, YouTube, Instagram, Facebook ou LinkedIn, mais sans doute pas Tournesol, Reconnexion, Qwice, Panodyssey ou encore needle.social. Ce dernier projet émane de la recherche publique en sciences humaines et sociales, développé au Centre de recherche sur les médiations (Crem) dans l’espoir de le mettre au service du secteur de la presse.

De longue date, l’impensé numérique traverse les discours médiatiques. Il consiste à présenter la technique comme une évidence au point de vider le débat public de tout questionnement politique ou velléité de résistance. Ainsi, en mettant l’accent sur des préoccupations tournées vers la santé des adolescents, le débat autour de l’interdiction des réseaux sociaux a contribué à détourner l’attention des enjeux démocratiques que soulève le modèle économique des plateformes dominantes.

Derrière l’urgence sanitaire, une urgence démocratique

Souvent résumé dans les médias à une opposition entre interdiction et éducation, le débat a fini par occulter le rôle prépondérant du modèle économique des plateformes pourtant identifié par l’Agence nationale de sécurité sanitaire. Là où réside un consensus scientifique, c’est bien pour condamner la responsabilité écrasante du modèle économique des Big Tech dans la dégradation de nos démocraties. C’est notamment le constat accablant du GIEC des écosystèmes d’information après avoir épluché près de 1 700 publications scientifiques :

« Les modèles économiques des grandes entreprises technologiques (Big Tech) incitent les enfants et les adultes connectés à autoriser l’extraction de données, qu’elles monétisent ensuite à des fins lucratives. Cette pratique facilite la diffusion virale de désinformation, de mésinformation et de discours de haine. »

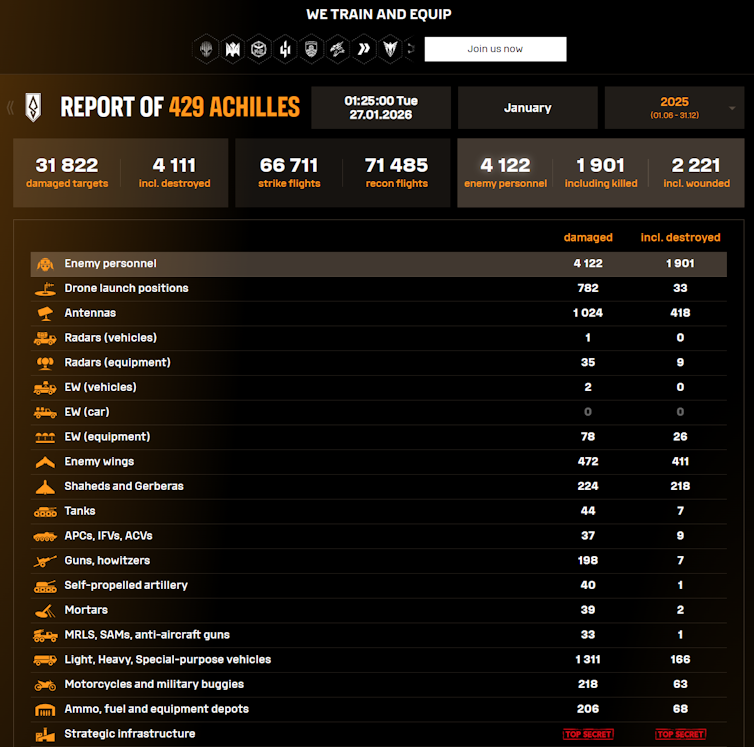

Le modèle économique des grandes plateformes numériques constitue un facteur majeur de l’accélération de la désinformation et de la mésinformation. La propagation des contenus malicieux est amplifiée à partir de métriques (likes, commentaires, partages, temps passé, etc.) qui provoquent l’emballement, selon un processus favorable aux contenus qui provoquent le plus de réactions.

Une action systémique contre l’économie de l’attention est possible

Il ne viendrait pas à l’idée de nos parlementaires d’interdire de « boire dans un verre au café » sous prétexte que les « verres » peuvent contenir une boisson alcoolisée. C’est bien la vente d’alcool aux mineurs qui est interdite. Si l’interdiction peut être débattue, elle doit porter sur des produits dont la nocivité est avérée. Or, le produit toxique des BigTech ce sont les enchères publicitaires qui conditionnent toute l’architecture algorithmique de leurs réseaux sociaux. Dans une note du MIT de 2024, quelques mois avant de recevoir le Nobel d’économie, Daron Acemoglu et Simon Johnson ont ainsi appelé à l’urgence de taxer la publicité numérique. L’enjeu : casser cette économie toxique, contraindre les Big Tech à imaginer d’autres modèles d’affaires et réouvrir la possibilité d’innover au travers de plateformes différentes.

La régulation a également un rôle à jouer. On serait en droit d’attendre l’application des lois européennes existantes, telles que le Règlement sur les services numériques (DSA) qui impose notamment aux plateformes des obligations quant à la modération des contenus partagés sur les réseaux sociaux (facilitation des signalement et coopération avec des signaleurs de confiance, possibilités de contestation pour les utilisateurs, transparence des algorithmes, accès des autorités et des chercheurs aux données, obligations d’audits indépendants…). Ainsi, le 6 février 2026, la Commission européenne a conclu à titre préliminaire que TikTok enfreignait la législation sur les services numériques en raison de sa conception addictive au travers de fonctionnalités telles que le défilement infini, la lecture automatique, les notifications push et son système de recommandation hautement personnalisé.

On serait tenté d’exiger que l’industrie du numérique démontre l’innocuité de ses produits avant leur commercialisation, comme c’est le cas pour les médicaments, les jouets ou les véhicules. Pourtant, dans les industries médiatiques, c’est l’éditeur qui est responsable a posteriori devant la loi. Le problème des plateformes tient davantage au fait qu’elles sont considérées comme des hébergeurs, alors qu’elles effectuent bien une sélection éditoriale de ce qui doit être propagé ou invisibilisé via leurs algorithmes. Comme n’importe quel média, elles pourraient être tenues de demander une autorisation de publication dès lors que la diffusion des contenus sort du cercle privé. Si le droit des médias s’impose (comme le prévoit un amendement adopté en première lecture), un contenu répréhensible peut faire l’objet d’une action en justice engageant la responsabilité pénale du directeur de publication. Pour l’éviter, l’intérêt des plateformes consistera à mettre enfin en œuvre une modération a priori qui empêche la propagation des contenus litigieux.

Comment faire émerger des réseaux sociaux alternatifs et vertueux ?

Une architecture stratégique issue des ateliers de lutte contre les manipulations de l’information considère nos écosystèmes informationnels comme des biens communs dont dépend la résilience informationnelle de nos sociétés : au même titre que le climat ou la biodiversité, il convient d’en prendre soin. Les instruments existent, déjà identifiés pour agir face à d’autres enjeux écologiques : investissement dans la recherche publique, incitations fiscales et économiques sur le modèle des labels environnementaux, développement de l’économie sociale et solidaire.

La recherche en sciences sociales alerte depuis plusieurs années sur les dérives des plateformes des BigTech, mais inventer et expérimenter des dispositifs sociotechniques alternatifs nécessite un engagement au long cours et l’appui d’ingénieurs informatiques pérennes : toutes choses que ne permettent pas les financements sur projets. L’absence de moyens pour innover en matière d’infrastructures d’information et de communication soucieuses de l’intérêt général contraste cruellement avec les investissements dans une « course à l’IA" » qui fait peu de cas de l’intelligence collective.![]()

Julien Falgas, Maître de conférences au Centre de recherche sur les médiations, Université de Lorraine et Dominique Boullier, Professeur des universités émérite en sociologie. Chercheur au Centre d'Etudes Européennes et de Politique Comparée, Sciences Po

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.