Par Yannick Chatelain, Grenoble École de Management (GEM)

Un an après l’ouverture au public de ChatGPT, l’intégration des IA génératives aux smartphones marque un nouveau tournant technologique.

Les « smartphones génératifs » ont fait leur début avec Google en octobre 2023 avec la sortie du Pixel 8 et du Pixel 8 Pro. Samsung a annoncé début novembre l’intégration de l’IA générative dans sa nouvelle gamme (Galaxy S24, Galaxy S24+, Galaxy S24 Ultra) : ils devraient être présentés par la firme le 17 janvier 2024, et être dotés de Gauss, un modèle d’IA générative de type chatbot développé par Samsung Research, et de Galaxy AI, une autre solution d’IA.

Cette intégration promet des améliorations majeures en fonctionnalités et performances, redéfinissant l’interaction quotidienne des utilisateurs avec leurs appareils. Mais en promettant de générer une foison de faux contenus, elle pose également des défis éthiques, juridiques et techniques, du chaos informationnel à la sécurisation des « vraies données ».

L’IA générative, des enjeux économiques et géopolitiques

L’IA générative englobe des modèles capables de créer de façon autonome divers contenus tels que texte, images, code, et contenu multimédia. Ces modèles apprennent à partir de vastes ensembles de données, produisant des résultats originaux indiscernables de créations humaines.

Son potentiel de transformation sociétale est incontestable, avec une utilisation croissante dans des contextes professionnels, qui confrontent les individus à l’IA générative. Cela est lié en tout premier lieu au fait de son intégration par les entreprises pour améliorer leurs performances, par exemple dans l’amélioration de la relation client ; mais aussi parce que sa maîtrise devient indispensable à l’exercice de nombreux métiers, notamment dans le paysage créatif : agences de publicité, services marketing, les entreprises numérique… et qu’elle en crée, à l’instar du nouveau métier de « prompt engineer », dont le rôle consiste à optimiser les requêtes faites au système d’intelligence artificielle afin d’obtenir une réponse la plus pertinente possible.

La démocratisation de l’IA générative, avec l’accessibilité de ChatGPT au grand public en novembre 2022, a conduit à une adoption massive, avec 100 millions d’utilisateurs deux mois après le lancement. Cela a suscité une attention considérable des médias et des universitaires, faisant de ChatGPT un « cas d’école » pour de nombreuses études sur ses impacts sociétaux, opportunités, défis et implications pour la recherche.

De façon plus large, des études ont été menées sur le potentiel économique de l’IA générative. Une étude de Mc Kinsey Digital insiste sur le levier de croissance que celle-ci représente pour les entreprises. Le marché de l’IA générative devrait atteindre en 2023 un chiffre d’affaires mondial de 42 milliards d’euros ; les analystes prévoyant une croissance moyenne de la taille du marché de l’ordre de 24 % par an (ce qui porterait un chiffre d’affaires annuel de plus de 200 milliards d’euros à l’horizon 2030).

L’IA générative est soutenue par de grandes entreprises telles que Microsoft, Google et Baidu, qui poursuivent aujourd’hui leur course au leadership. Pour exemple, S. Nadella, CEO de Microsoft, annonçait le 23 janvier 2023 prévoir d’investir plusieurs milliards de dollars sur les prochaines années dans OpenAI – qui a lancé ChatGPT (10 milliards selon Bloomberg).

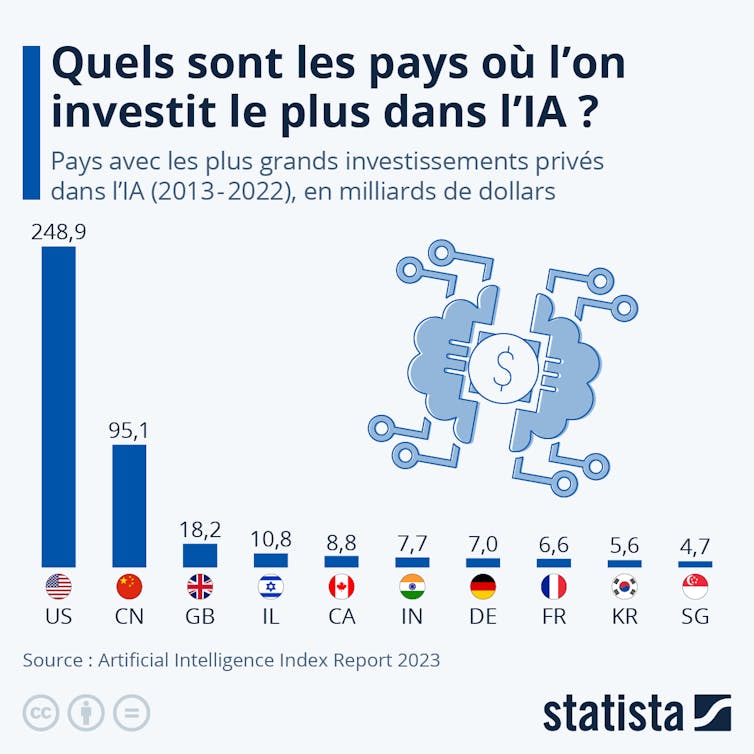

Même si certains pays se montrent prudents, voire alarmistes, ces technologies sont aussi vues comme un enjeu géopolitique par de nombreux pays.

Dans ce contexte, les acteurs de l’IA, les dirigeants du monde des affaires, les gouvernements, tout comme la société civile ont des défis tout aussi vertigineux à relever, des défis éthiques (mésusages), des défis de sécurisation de données…

L’IA générative dans les smartphones Google et Samsung offre des applications puissantes, mais pose des risques et défis liés à la manipulation de contenus et à la sécurité des données par des utilisateurs nouvellement habilités par leur smartphone.

Le chaos informationnel, premier risque majeur avec les utilisateurs d’un nouveau type

En permettant de manipuler les contenus à l’envi, l’intégration de systèmes d’IA générative aux smartphones risque de provoquer la prolifération de deepfakes et d’accentuer la diffusion de ces contenus faux mais crédibles. Ceci pourrait compromettre davantage la crédibilité des informations en ligne et entraîner un chaos informationnel généralisé.

Sans compter un risque qui peut s’avérer mortel : l’explosion potentielle du cyberharcèlement, notamment via le « deepfake porn », une pratique violente qui a émergé en 2017 et qui va se trouver « facilitée » avec l’arrivée de l’IA générative dans les smartphones.

La sécurisation des données d’apprentissage

Les modèles génératifs peuvent créer des données : des images par exemple, qui ressemblent de manière frappante à des données réelles. Cela peut donc être utilisé de manière malveillante pour créer des contrefaçons, des faux, des contenus trompeurs que ces derniers soient textuels et servent par exemple des arnaques comme le phishing, ou visuels : montages photos, montages vidéo (DeepFake).

Par ailleurs, des données erronées peuvent être fabriquées par un modèle génératif malveillant. Celles-ci pourraient être utilisées dans les corpus d’apprentissage des futurs grands modèles de langage (large language models ou LLM, dont ChatGPT est l’exemple le plus connu) ou d’autres modèles d’intelligence artificielle.

En effet, certains modèles génératifs peuvent se révéler vulnérables à des « attaques par exemples contradictoires » (adversarial attacks, dont l’exemple classique pour un modèle de machine learning est d’introduire de fausses données dans la base de données d’apprentissage, provoquant un véhicule à voir une limitation de vitesse à la place d’un panneau-stop).

L’évolution de ce type d’adversarial attack cible désormais les IA génératives, par exemple avec le data poisoning.

Qui sera responsable en cas d’utilisation inappropriée des générations issues de ces modèles ?

L’avenir des avancées de l’IA générative dépend de la capacité globale de la société (gouvernements, citoyens, entreprises, ONG, etc.) à naviguer avec responsabilité dans ces territoires inexplorés.

L’utilisation irresponsable des « smartphones génératifs » pose des questions éthiques et juridiques sur la responsabilité des créateurs de modèles et des entreprises qui les rendent accessibles au grand public.

Certes, des outils existent tels que Deepware Scanner ou Microsoft Video Authenticator pour analyser des vidéos et tenter de détecter des signes de manipulation. Si les plates-formes peuvent intégrer des outils de détection directement dans leurs systèmes de modération, cette détection est encore loin d’être fiable.

Distinguer les deepfakes acceptables, c’est-à-dire respectueux du droit du pays d’appartenance de l’utilisateur, sans recourir à la censure semble un défi insurmontable, voire impossible. Dans un contexte concurrentiel, la prudence de Timothy Cook, DG d’Apple, qui entend entrer dans le jeu quand les questions éthiques seront mieux défrichées, est louable. L’histoire dira si éthique et responsabilité sont des facteurs clés de succès dans notre époque tumultueuse.![]()

Yannick Chatelain, Professeur Associé. Digital I IT. GEMinsights Content Manager, Grenoble École de Management (GEM)

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.